Blog van medewerkers

- Vermeld expliciet wanneer een algoritme is gebruikt.

- Leg uit welke rol het heeft gespeeld bij het besluit.

- Geef inzicht in de mogelijke risico’s, zoals

bias of discriminatie.

Meer dan vakjes aankruisen

De rechter maakt ook korte metten met het idee dat een standaardformulier voldoende is om een besluit te motiveren. Onder verwijzing naar de Awb, het Handvest van de EU en het EVRM stelt de rechtbank dat de motivering concreet, op de zaak toegespitst en controleerbaar moet zijn. Algemene teksten of het simpelweg aanvinken van opties op een formulier zijn onvoldoende. Daarnaast wees de rechtbank op het belang van een hoorzitting in de bezwaarfase. Daarvan mag slechts worden afgezien als op voorhand vaststaat dat het bezwaar geen kans van slagen heeft. Dat was in deze zaak niet het geval.Lessen voor bestuursorganen

Deze uitspraak geeft een aantal duidelijke lessen:Registreer elk algoritme in het Algoritmeregister, ook als het alleen ondersteunend wordt ingezet.Wees proactief transparant in besluiten over de inzet, werking en invloed van het algoritme.Motiveer concreet – meer dan alleen vakjes aanvinken. Leg uit waarom de specifieke feiten en omstandigheden leiden tot het besluit.Voer een Impact Assessment Mensenrechten en Algoritmes (IAMA) uit, zeker bij algoritmes die risicoprofielen maken of gevoelige kenmerken gebruiken.Publiceer IAMA-rapporten, zodat burgers en rechters inzicht hebben in de risico’s en waarborgen.

Wat ik voor u kan doen

Als IT-advocaat (wijst@bg.legal) met een specialisatie in de juridische aspecten van AI ondersteun ik bestuursorganen bij:- Het verantwoord inzetten van

algoritmesin besluitvormingsprocessen. - Het vormgeven van transparantie en motivering, zodat besluiten juridisch houdbaar zijn.

- Het begeleiden van

IAMA’sen het correct vastleggen en publiceren van de resultaten.

[post_title] => Rechtbank: Transparantie over algoritmes in besluitvorming is geen optie maar verplichting

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => rechtbank-transparantie-over-algoritmes-in-besluitvorming-is-geen-optie-maar-verplichting

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-13 10:20:45

[post_modified_gmt] => 2025-08-13 08:20:45

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45457

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[1] => WP_Post Object

(

[ID] => 45384

[post_author] => 6

[post_date] => 2025-08-01 15:34:12

[post_date_gmt] => 2025-08-01 13:34:12

[post_content] => IT-juristen weten het al jaren:

[post_title] => Rechtbank: Transparantie over algoritmes in besluitvorming is geen optie maar verplichting

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => rechtbank-transparantie-over-algoritmes-in-besluitvorming-is-geen-optie-maar-verplichting

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-13 10:20:45

[post_modified_gmt] => 2025-08-13 08:20:45

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45457

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[1] => WP_Post Object

(

[ID] => 45384

[post_author] => 6

[post_date] => 2025-08-01 15:34:12

[post_date_gmt] => 2025-08-01 13:34:12

[post_content] => IT-juristen weten het al jaren: De uitdaging: juridisch kaderen van agile/scrum

In deze zaak draait het om de ontwikkeling van een front-end via een agile/scrum-aanpak, met levering in sprints en een "definition of done". Triple IT factureerde voor haar werkzaamheden, terwijl On Air betaling weigerde, stellende dat niet aan de afgesproken voorwaarden was voldaan. Volgens On Air was geen sprake van deugdelijke oplevering, laat staan acceptatie. Het hof constateert echter dat het simpelweg ontbreken van een concrete opleverdatum — een typisch kenmerk van agile werken — het juridisch kader bemoeilijkt. Wat betekent ‘oplevering’ binnen agile? Is het label ‘done’ inDeskundige moet terminologie en praktijk uitleggen

In het tussenarrest van april 2024[1] besluit het hof dan ook om eenTraagheid en kosten van de procedure

De rechtbank deed uitspraak in maart 2022. Pas in april 2024 besluit het hof tot een deskundigenonderzoek. In juli 2025[2] wordt de deskundige officieel benoemd. De verwachting is dat het rapport pas in of na december 2025 beschikbaar komt, waarna partijen mogen reageren. Een einduitspraak? Niet eerder dan medio 2026. Een slepende hoger beroep procedure van vier jaar is dan een feit.Had dit beter gekund? Ja: arbitrage en duidelijke contracten

Een geschil als dit illustreert waarom partijen inConclusie

Deze zaak laat zien dat juridische systemen nog steeds moeite hebben om wendbare ontwikkelmethoden juridisch te duiden. Een deskundige moet nu de rechter helpen om agile te begrijpen. Maar had dit voorkomen kunnen worden? Absoluut, met duidelijke definities, goede documentatie, betere communicatie met de opdrachtgever en waar nodig een alternatieve geschilbeslechting via arbitrage c.q. bindend advies. Heb je hier vragen over? Neem dan contact op met Jos van der Wijst. [1] Gerechtshof Amsterdam, 23 april 2024, ECLI:NL:GHAMS:2024:1070 [2] Gerechtshof Amsterdam, 15 juli 2025, ECLI:NL:GHAMS:2025:1814 [post_title] => Agile, sprints en ‘done’ in de rechtszaal: Waarom rechters IT-deskundigen nodig hebben

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => agile-sprints-en-done-in-de-rechtszaal-waarom-rechters-it-deskundigen-nodig-hebben

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-15 14:42:35

[post_modified_gmt] => 2025-08-15 12:42:35

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45384

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[2] => WP_Post Object

(

[ID] => 45409

[post_author] => 6

[post_date] => 2025-08-01 13:31:59

[post_date_gmt] => 2025-08-01 11:31:59

[post_content] => Vanaf 28 juni 2025 treedt de European Accessibility Act (EAA) in werking in Nederland. De wet verplicht organisaties om digitale diensten — zoals websites, webshops, apps en ticketautomaten — toegankelijk te maken voor mensen met een beperking. De EAA wordt via aanpassingen in de Warenwet, de Wet op het financieel toezicht en het Burgerlijk Wetboek in Nederlandse regelgeving verankerd. Voor de uitvoering wordt teruggegrepen op de Web Content Accessibility Guidelines (WCAG). Dit zijn internationale richtlijnen en aanbevelingen voor digitale toegankelijkheid.

[post_title] => Agile, sprints en ‘done’ in de rechtszaal: Waarom rechters IT-deskundigen nodig hebben

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => agile-sprints-en-done-in-de-rechtszaal-waarom-rechters-it-deskundigen-nodig-hebben

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-15 14:42:35

[post_modified_gmt] => 2025-08-15 12:42:35

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45384

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[2] => WP_Post Object

(

[ID] => 45409

[post_author] => 6

[post_date] => 2025-08-01 13:31:59

[post_date_gmt] => 2025-08-01 11:31:59

[post_content] => Vanaf 28 juni 2025 treedt de European Accessibility Act (EAA) in werking in Nederland. De wet verplicht organisaties om digitale diensten — zoals websites, webshops, apps en ticketautomaten — toegankelijk te maken voor mensen met een beperking. De EAA wordt via aanpassingen in de Warenwet, de Wet op het financieel toezicht en het Burgerlijk Wetboek in Nederlandse regelgeving verankerd. Voor de uitvoering wordt teruggegrepen op de Web Content Accessibility Guidelines (WCAG). Dit zijn internationale richtlijnen en aanbevelingen voor digitale toegankelijkheid.

Voor wie geldt de EAA?

- Webshops, e-commerce-sites en reserveringsplatforms

- Apps en websites van organisaties die audiovisuele mediadiensten, financiële producten, e-books of zelfbedieningsterminals aanbieden

Wat betekent dit voor websitebouwers?

- "Voldoet dit website-ontwerp aan EAA?"

- "Hoe verwerk ik WCAG in mijn projecten?"

- "Wat moet er in toegankelijkheidsverklaringen?"

- Accessibility audit / checks aanbieden – gebruik tools om te toetsen op WCAG 2.1-niveau AA.

- Toegankelijkheid ‘by design’ borgen – start bij designfase met EN 301 549 en WCAG-protocollen.

- Toegankelijkheidsverklaring & rapportage – minimaal 50 richtlijnen beoordelen en/of plannen binnen 6 maanden.

- Insluiting van bestaande sites & updates – ook bestaande sites kunnen onder de wet vallen bij significante updates.

- MKB Nederland: 70 % van websites nog niet toegankelijk.

- Webbouwers zoeken naar praktische handvatten en tooling.

- Ook zorg, banken, reisplatforms en vervoer bereiden zich actief voor.

Veelgestelde vragen aan websitebouwers:

Valt deze website onder de EAA?

Moet ik WCAG TT toetsen?

Hoe gaan we om met updates?

Hoe formuleer je een verklaring?

- Juridisch advies over reikwijdte en uitzonderingen (hoe moet je termen uitleggen?)

- Opstellen van toegankelijke designrichtlijnen

- Begeleiden van audits en verklaringen

- Strategie bij klantondersteuning

[post_title] => European Accessibility Act: wat moeten webbouwers nú weten?

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => european-accessibility-act-wat-moeten-webbouwers-nu-weten

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 14:36:30

[post_modified_gmt] => 2025-08-04 12:36:30

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45409

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[3] => WP_Post Object

(

[ID] => 45351

[post_author] => 6

[post_date] => 2025-07-30 16:18:17

[post_date_gmt] => 2025-07-30 14:18:17

[post_content] => Als ondernemer sta je bij een overname voor strategische keuzes. Zeker wanneer je het bedrijf van

[post_title] => European Accessibility Act: wat moeten webbouwers nú weten?

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => european-accessibility-act-wat-moeten-webbouwers-nu-weten

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 14:36:30

[post_modified_gmt] => 2025-08-04 12:36:30

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45409

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[3] => WP_Post Object

(

[ID] => 45351

[post_author] => 6

[post_date] => 2025-07-30 16:18:17

[post_date_gmt] => 2025-07-30 14:18:17

[post_content] => Als ondernemer sta je bij een overname voor strategische keuzes. Zeker wanneer je het bedrijf van Geen ‘kat in de zak’ – maar toch een miskoop?

XIXO B.V., zelf een ICT-dienstverlener, nam eind 2023 AllSystems over. Al snel nadat de overname rond was kwamen er diverse problemen aan het licht: licenties bleken niet in orde, cijfers verschilden van eerdere overzichten en klanten bleken minder loyaal dan gedacht. XIXO claimde dat ze de onderneming nooit had gekocht als ze dit had geweten en stapte naar de rechter. Toch wees de rechtbank de vorderingen af. Belangrijk was dat de koper al vóór de transactie kennis had van diverse gebreken. TijdensDue diligence: een (gemiste) kans

De uitspraak onderstreept dat partijen bij een overname zelf verantwoordelijk zijn voor het uitvoeren van een zorgvuldig onderzoek (due diligence). XIXO had signalen ontvangen over administratieve fouten en licentieproblemen. Haar eigen technisch manager schreef nog vóór de overdracht dat er een ernstige compliance issue zou zijn voor wat betreft de licenties van de omgeving. Desondanks besloot XIXOUitsluiten van ontbinding of vernietiging

Het klantenbestand

Een ander leerpunt is de rol vanDe les: IT-overnames zijn complex, laat due dilligence uitvoeren

Deze uitspraak bevestigt dat bij de overname van eWees voorbereid

Bij BG.legal voeren wij (technische) due diligence uit en begeleiden wij IT-ondernemers en kopers in het hele overnameproces. Overweegt u een IT-bedrijf over te nemen of te verkopen? Neem tijdig contact op met onze IT-specialist Jos van der Wijst en/of onze overnamespecialist Daniëlle Hack. [post_title] => Aandachtspunten bij een overname van een IT-bedrijf

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => aandachtspunten-bij-een-overname-van-een-it-bedrijf

[to_ping] =>

[pinged] =>

[post_modified] => 2025-07-30 16:18:17

[post_modified_gmt] => 2025-07-30 14:18:17

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45351

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[4] => WP_Post Object

(

[ID] => 45406

[post_author] => 6

[post_date] => 2025-07-30 14:05:11

[post_date_gmt] => 2025-07-30 12:05:11

[post_content] => De Digital Services Act (DSA) wordt vaak gezien als een wet die alleen geldt voor de allergrootste techbedrijven — zoals Meta, Google of TikTok. Maar dat is een misvatting. Veel organisaties die online diensten aanbieden vallen óók onder de DSA. Dat geldt met name voor platforms die consumenten en aanbieders met elkaar verbinden: marktplaatsen, ticketwebsites, recensiesites en communityfora.

[post_title] => Aandachtspunten bij een overname van een IT-bedrijf

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => aandachtspunten-bij-een-overname-van-een-it-bedrijf

[to_ping] =>

[pinged] =>

[post_modified] => 2025-07-30 16:18:17

[post_modified_gmt] => 2025-07-30 14:18:17

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45351

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[4] => WP_Post Object

(

[ID] => 45406

[post_author] => 6

[post_date] => 2025-07-30 14:05:11

[post_date_gmt] => 2025-07-30 12:05:11

[post_content] => De Digital Services Act (DSA) wordt vaak gezien als een wet die alleen geldt voor de allergrootste techbedrijven — zoals Meta, Google of TikTok. Maar dat is een misvatting. Veel organisaties die online diensten aanbieden vallen óók onder de DSA. Dat geldt met name voor platforms die consumenten en aanbieders met elkaar verbinden: marktplaatsen, ticketwebsites, recensiesites en communityfora.

Wat zijn de criteria om onder de DSA te vallen?

- Hostingdiensten (websites met door gebruikers gegenereerde content)

- Online platforms (zoals e-commerceplatforms, reviewwebsites, digitale marktplaatsen)

- Advertentiediensten die gebruikers en adverteerders matchen

Recente handhavingsontwikkelingen

- De Europese Commissie klaagt vijf lidstaten aan wegens gebrekkige DSA-implementatie

- Platform X (voorheen Twitter) moet logbestanden en API’s beschikbaar stellen voor toezicht

- Leeftijdsverificatie-apps worden getest in vijf EU-lidstaten om jongeren online beter te beschermen

Wat moet je als organisatie nu doen?

- Een meld- en verwijderprocedure voor illegale content (Art. 16)

- Een toegankelijk klachtenmechanisme (Art. 20)

- Transparantie over moderatie, advertenties en algoritmische aanbevelingen (Art. 15–17)

- Eventueel een risicobeoordeling en maatregelen tegen desinformatie of manipulatie (Art. 34–37)

Wat betekent dit voor de praktijk?

Bied je een digitale dienst of platform aan? Dan is de kans groot dat je onder de DSA valt. De regelgeving geldt ook voor Europese platforms van bescheiden omvang.- Beoordeling of je onder de DSA valt

- Opzetten van meld- en klachtenprocedures

- Transparantiebeleid en auditvoorbereiding

- Implementatie van DSA-compliant processen

[post_title] => Digital Services Act: ook jouw platform valt eerder onder de regels dan je denkt

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => digital-services-act-ook-jouw-platform-valt-eerder-onder-de-regels-dan-je-denkt

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 14:29:45

[post_modified_gmt] => 2025-08-04 12:29:45

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45406

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[5] => WP_Post Object

(

[ID] => 45403

[post_author] => 6

[post_date] => 2025-07-25 09:52:34

[post_date_gmt] => 2025-07-25 07:52:34

[post_content] => Data spaces zijn gespecialiseerde, sectorale platformen waar organisaties veilig data kunnen delen, samenwerken en innoveren. In het tweede kwartaal van 2025 zijn er belangrijke ontwikkelingen die laten zien dat data spaces nu écht relevant worden — ook voor organisaties buiten multinational-niveau.

[post_title] => Digital Services Act: ook jouw platform valt eerder onder de regels dan je denkt

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => digital-services-act-ook-jouw-platform-valt-eerder-onder-de-regels-dan-je-denkt

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 14:29:45

[post_modified_gmt] => 2025-08-04 12:29:45

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45406

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[5] => WP_Post Object

(

[ID] => 45403

[post_author] => 6

[post_date] => 2025-07-25 09:52:34

[post_date_gmt] => 2025-07-25 07:52:34

[post_content] => Data spaces zijn gespecialiseerde, sectorale platformen waar organisaties veilig data kunnen delen, samenwerken en innoveren. In het tweede kwartaal van 2025 zijn er belangrijke ontwikkelingen die laten zien dat data spaces nu écht relevant worden — ook voor organisaties buiten multinational-niveau.

Recente ontwikkelingen per sector

Waarom dit nú relevant is voor jouw organisatie

Organisaties in sectoren zoals maakindustrie, biotech, voeding of medische technologie denken soms dat data spaces alleen relevant zijn voor grote corporates. Maar dat is te kort door de bocht:- EHDS raakt nú al ziekenhuizen, onderzoekslabs en start-ups die met gezondheiddata werken

- Manufacturing-initiatieven als Data Space 4.0 betrekken ook mkb-bedrijven als dataleveranciers of afnemers in pilots

- Agro-data-initiatieven bewegen richting gedeelde landbouwgegevens als hefboom voor innovatie in klimaatadaptatie en voedselketentransparantie.

Wat moet jouw organisatie nú doen?

- Inventariseer sectorale data-initiatieven (EHDS in gezondheid, Data Space 4.0 en SCSN in maakindustrie, agro-pilots)

- Beoordeel je datapotentieel: welke data heb je die andere partijen waarderen?

- Neem deel aan governance en standaardenwerk

- Zorg dat technische interoperabiliteit haalbaar is: gebruik open standaarden en FAIR-principes

Wat betekent dit voor de praktijk?

- Analyse van sectorale data projects waaraan je kunt deelnemen

- Juridisch ontwerp van governance-modellen en contractuele dataspace-afspraken

- Begeleiding bij deelname aan EU-projecten zoals Data Space 4.0, SCSN, EHDS of agro-data-initiatieven

- Compliance-checks op FAIR-principes, privacy en eigendomsrechten

[post_title] => Data Spaces in opkomst: gezondheidszorg, industrie & agro onder de loep

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => data-spaces-in-opkomst-gezondheidszorg-industrie-agro-onder-de-loep

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 14:04:33

[post_modified_gmt] => 2025-08-04 12:04:33

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45403

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[6] => WP_Post Object

(

[ID] => 45401

[post_author] => 6

[post_date] => 2025-07-23 13:48:54

[post_date_gmt] => 2025-07-23 11:48:54

[post_content] => Op 2 april 2025 publiceerde de Europese Commissie via haar Expert Group on B2B Data Sharing and Cloud Computing Contracts officieel de niet-bindende Model Contractual Terms (MCTs) en Standard Contractual Clauses (SCCs) onder Artikel 41 van de EU Data Act. Deze templates zijn onderdeel van de uitvoering van de Data Act, die per 12 september 2025 in werking treedt. De documenten zijn terug te vinden op de officiële site van de Europese Commissie:

[post_title] => Data Spaces in opkomst: gezondheidszorg, industrie & agro onder de loep

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => data-spaces-in-opkomst-gezondheidszorg-industrie-agro-onder-de-loep

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 14:04:33

[post_modified_gmt] => 2025-08-04 12:04:33

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45403

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[6] => WP_Post Object

(

[ID] => 45401

[post_author] => 6

[post_date] => 2025-07-23 13:48:54

[post_date_gmt] => 2025-07-23 11:48:54

[post_content] => Op 2 april 2025 publiceerde de Europese Commissie via haar Expert Group on B2B Data Sharing and Cloud Computing Contracts officieel de niet-bindende Model Contractual Terms (MCTs) en Standard Contractual Clauses (SCCs) onder Artikel 41 van de EU Data Act. Deze templates zijn onderdeel van de uitvoering van de Data Act, die per 12 september 2025 in werking treedt. De documenten zijn terug te vinden op de officiële site van de Europese Commissie:

Wat staat er in de modelcontracten?

- Datahouder → Gebruiker (bijv. autofabrikant aan voertuigbezitter)

- Gebruiker → Derde partij op verzoek van de gebruiker

- Datahouder → Derde partij na gebruikersverzoek

- Vrijwillige datadeling zonder gebruikersinitiatief

In balans of bevooroordeeld?

De centrale vraag is of de MCTs vooral in het voordeel zijn van de datahouder of juist van de data-ontvanger. Uit een analyse blijkt dat de modellen zijn ontworpen met oog voor transparantie, billijkheid en non-discriminatie. Toch bieden sommige bepalingen ruimte voor interpretatie in het voordeel van de datahouder, bijvoorbeeld rond ‘redelijke vergoeding’ of geheimhoudingsplichten.Voor wie is dit nú belangrijk?

- Fabrikanten van IoT- en connected apparaten

- Cloud- en platformproviders

- Datadienstenbedrijven (mobiliteit, smart building, industrie 4.0)

- Bedrijven die data delen op verzoek van gebruikers

Wat betekent dit voor de praktijk?

- Contracten toetsen aan MCTs/SCCs

- Vergoedings- en geheimhoudingsbepalingen herzien

- Procedures rond datatoegang en exit op orde hebben

Wij helpen je met:

- Contractscan van je bestaande overeenkomsten

- Maatwerkcontracten op basis van MCTs/SCCs

- Juridisch advies en strategische begeleiding

[post_title] => Modelcontracten EU Data Act: eerlijk verdeeld of bevoordeelt één partij?

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => modelcontracten-eu-data-act-eerlijk-verdeeld-of-bevoordeelt-een-partij

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 13:49:26

[post_modified_gmt] => 2025-08-04 11:49:26

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45401

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[7] => WP_Post Object

(

[ID] => 45399

[post_author] => 6

[post_date] => 2025-07-18 11:30:06

[post_date_gmt] => 2025-07-18 09:30:06

[post_content] => Veel onderzoekers gaan er vanuit dat de EU AI Act niet van toepassing is op hun wetenschappelijke werk. Een recente analyse van Wernick & Meding van 3 juni 2025 laat echter zien dat deze aanname niet altijd klopt.

De Artificial Intelligence Act (AI Act), aangenomen in juli 2024, is de eerste grootschalige wetgeving die AI reguleert op basis van risicocategorieën. Denk aan verboden AI-systemen, high-risk AI en General Purpose AI models (GPAI). De wet bevat uitzonderingen voor wetenschappelijk onderzoek, maar in de praktijk blijken deze uitzonderingen beperkt toepasbaar.

[post_title] => Modelcontracten EU Data Act: eerlijk verdeeld of bevoordeelt één partij?

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => modelcontracten-eu-data-act-eerlijk-verdeeld-of-bevoordeelt-een-partij

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 13:49:26

[post_modified_gmt] => 2025-08-04 11:49:26

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45401

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[7] => WP_Post Object

(

[ID] => 45399

[post_author] => 6

[post_date] => 2025-07-18 11:30:06

[post_date_gmt] => 2025-07-18 09:30:06

[post_content] => Veel onderzoekers gaan er vanuit dat de EU AI Act niet van toepassing is op hun wetenschappelijke werk. Een recente analyse van Wernick & Meding van 3 juni 2025 laat echter zien dat deze aanname niet altijd klopt.

De Artificial Intelligence Act (AI Act), aangenomen in juli 2024, is de eerste grootschalige wetgeving die AI reguleert op basis van risicocategorieën. Denk aan verboden AI-systemen, high-risk AI en General Purpose AI models (GPAI). De wet bevat uitzonderingen voor wetenschappelijk onderzoek, maar in de praktijk blijken deze uitzonderingen beperkt toepasbaar.

Wanneer raakt de AI Act het onderzoek?

De AI Act stelt verplichtingen aan aanbieders van AI-systemen, zodra die op de Europese markt beschikbaar worden gesteld of in gebruik worden genomen – zelfs gratis en zelfs door universiteiten of onderzoeksinstellingen. Veelgebruikte handelingen binnen AI-onderzoek, zoals het uploaden van modellen naar GitHub of Hugging Face, kunnen worden gezien als het "op de markt brengen" van AI-modellen. Daarmee kunnen onderzoekers onbedoeld onder het toepassingsbereik van de wet vallen.- Een universiteit die een model voor gezichtsherkenning ontwikkelt en publiceert kan vallen onder verboden AI-systemen.

- Onderzoek naar AI voor medische apparaten of onderwijs kan worden gezien als high-risk AI, waarvoor een risicobeheerssysteem, documentatieverplichtingen en meldplichten gelden.

- Het publiceren van een Large Language Model (LLM), zelfs open source, valt mogelijk onder de verplichtingen voor GPAI. Deze verplichtingen worden verder uitgewerkt in een Code of Practice.

Maar er zijn toch uitzonderingen?

- Wetenschappelijk onderzoek (artikel 2(6))

- Productgericht onderzoek en ontwikkeling (artikel 2(8))

- Open source modellen (artikel 2(12))

Concrete risico's voor onderzoekers

- Boetes voor overtreding kunnen oplopen tot 35 miljoen euro (artikel 99 AI Act).

- Onzekerheid over of het publiceren van een model als ‘markttoegang’ wordt beschouwd.

- Vage definities, zoals het verschil tussen een AI-systeem en AI-model.

Wat betekent dit in de praktijk?

- De classificatie van hun systeem: verboden, high-risk, of GPAI.

- Of hun publicaties mogelijk onder ‘in gebruik nemen’ of ‘op de markt brengen’ vallen.

- Of uitzonderingen wel van toepassing zijn.

- Toepasselijkheid van de AI Act op uw onderzoeksproject

- Publicatiepraktijken en disclaimers voor AI-modellen

- Juridische risico's bij samenwerking met commerciële partners

- Interpretatie van uitzonderingen in de AI Act

[post_title] => De AI Act raakt wetenschappelijk onderzoek: meer verplichtingen dan gedacht

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => de-ai-act-raakt-wetenschappelijk-onderzoek-meer-verplichtingen-dan-gedacht

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 11:55:08

[post_modified_gmt] => 2025-08-04 09:55:08

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45399

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[8] => WP_Post Object

(

[ID] => 45397

[post_author] => 6

[post_date] => 2025-07-15 09:00:56

[post_date_gmt] => 2025-07-15 07:00:56

[post_content] => Steeds vaker zetten leveranciers AI-toepassingen in bij dienstverlening. Denk aan automatische rapportage, geautomatiseerde chats of datagedreven analyses. Als jouw organisatie hierover niets heeft vastgelegd in de inkoopvoorwaarden of leveringsvoorwaarden, loop je risico. Daarom is het essentieel om AI-gerelateerde clausules in je contracten en voorwaarden op te nemen.

[post_title] => De AI Act raakt wetenschappelijk onderzoek: meer verplichtingen dan gedacht

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => de-ai-act-raakt-wetenschappelijk-onderzoek-meer-verplichtingen-dan-gedacht

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 11:55:08

[post_modified_gmt] => 2025-08-04 09:55:08

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45399

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[8] => WP_Post Object

(

[ID] => 45397

[post_author] => 6

[post_date] => 2025-07-15 09:00:56

[post_date_gmt] => 2025-07-15 07:00:56

[post_content] => Steeds vaker zetten leveranciers AI-toepassingen in bij dienstverlening. Denk aan automatische rapportage, geautomatiseerde chats of datagedreven analyses. Als jouw organisatie hierover niets heeft vastgelegd in de inkoopvoorwaarden of leveringsvoorwaarden, loop je risico. Daarom is het essentieel om AI-gerelateerde clausules in je contracten en voorwaarden op te nemen.

Wat moet je opnemen in je contracten?

Transparantieverplichting

Toestemming vooraf

Aansprakelijkheid en auditrecht

IP-eigendomsrechten en outputrechten

Privacy en vertrouwelijkheid

Audit en reviewrecht

Beëindiging en exit

Wat betekent dit voor de praktijk?

Standaard inkoopvoorwaarden zijn zelden voorbereid op AI-implementaties. Gebruikers lopen risico op onverwachte aansprakelijkheid, verlies van inhoudelijke controle en beperkte inzage in algoritmische beslissingen. Door AI-specifieke clausules op te nemen:- Behoud je transparantie en governance

- Beperk je technologische risico’s

- Zorg je voor juridische zekerheid bij inzet van Generative AI, Predictive AI of andere toepassingen

Wij ondersteunen je bij AI-proof contracteren met:

- Actualiseren van inkoop- of leveringsvoorwaarden met AI-clausules

- Implementatie van transparantie-, toestemming- en auditbepalingen

- Opstellen van IP-voorwaarden voor AI-output en datarechten

- Ondersteuning bij onderhandelingen met leveranciers over AI gebruik

[post_title] => AI in contracten: dit moet je opnemen in inkoop- en leveringsvoorwaarden

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => ai-in-contracten-dit-moet-je-opnemen-in-inkoop-en-leveringsvoorwaarden

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 11:21:51

[post_modified_gmt] => 2025-08-04 09:21:51

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45397

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[9] => WP_Post Object

(

[ID] => 45394

[post_author] => 6

[post_date] => 2025-07-11 14:31:42

[post_date_gmt] => 2025-07-11 12:31:42

[post_content] => Op 10 juli 2025 publiceerde de Europese Commissie de definitieve General-Purpose AI Code of Practice (GPAI-Code). Deze code biedt richtsnoeren voor aanbieders van general-purpose AI-modellen zoals GPT-4, Gemini of Claude en is gericht op transparantie, veiligheid, copyright-compliance en risicobeheer. De GPAI-code ondersteunt bij naleving van de AI Act (artikelen 53 en 55).

[post_title] => AI in contracten: dit moet je opnemen in inkoop- en leveringsvoorwaarden

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => ai-in-contracten-dit-moet-je-opnemen-in-inkoop-en-leveringsvoorwaarden

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 11:21:51

[post_modified_gmt] => 2025-08-04 09:21:51

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45397

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[9] => WP_Post Object

(

[ID] => 45394

[post_author] => 6

[post_date] => 2025-07-11 14:31:42

[post_date_gmt] => 2025-07-11 12:31:42

[post_content] => Op 10 juli 2025 publiceerde de Europese Commissie de definitieve General-Purpose AI Code of Practice (GPAI-Code). Deze code biedt richtsnoeren voor aanbieders van general-purpose AI-modellen zoals GPT-4, Gemini of Claude en is gericht op transparantie, veiligheid, copyright-compliance en risicobeheer. De GPAI-code ondersteunt bij naleving van de AI Act (artikelen 53 en 55).

Voor ontwikkelaars van AI-tools op basis van GPAI-modellen

Ontwikkel je een AI-tool die gebruikmaakt van een GPAI-model?- Transparantieverplichtingen: je moet documentatie opstellen over de modelarchitectuur, gebruikte trainingsdata (categorieën), energieverbruik, gebruiksdoeleinden en licenties.

- Model Documentation Form: je moet deze binnen 14 dagen kunnen verstrekken aan downstream-gebruikers of toezichthouders.

- Copyright-compliance: procedures voor bezwaar van rechthebbenden, filtering en metadata-integratie zijn vereist.

- Veiligheid en monitoring: risicobeheersplannen, incidentresponse en onafhankelijke audits worden aanbevolen voor grote modellen.

Voor gebruikers van AI-tools

Ben je gebruiker of afnemer van een AI-oplossing gebaseerd op GPAI?- Inzage in technische documentatie: je kunt informatie eisen over training, modelbeperkingen en copyrightbeleid.

- Evaluatie van risico’s: je kunt zelf beoordelen of het model veilig en betrouwbaar is op basis van aangeleverde documentatie.

- Meer zekerheid: een aanbieder die de GPAI-code toepast, voldoet vermoedelijk aan de AI Act. Dit vergroot jouw juridische zekerheid.

Wat betekent dit voor de praktijk?

Voor ontwikkelaars/aanbieders: [post_title] => Wat betekent de GPAI-Code of Practice voor AI-tools gebaseerd op general-purpose modellen?

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => wat-betekent-de-gpai-code-of-practice-voor-ai-tools-gebaseerd-op-general-purpose-modellen

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 10:32:23

[post_modified_gmt] => 2025-08-04 08:32:23

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45394

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

)

[post_count] => 10

[current_post] => -1

[before_loop] => 1

[in_the_loop] =>

[post] => WP_Post Object

(

[ID] => 45457

[post_author] => 6

[post_date] => 2025-08-13 10:19:13

[post_date_gmt] => 2025-08-13 08:19:13

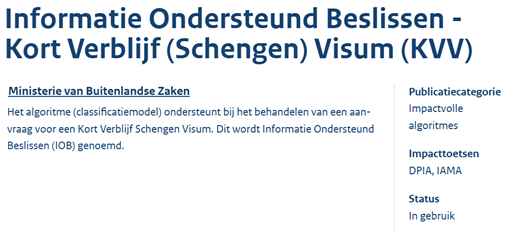

[post_content] => De Rechtbank Den Haag heeft in een recente tussenuitspraak opnieuw benadrukt dat bestuursorganen verplicht zijn transparant te zijn over het gebruik van algoritmes in hun besluitvorming. Dat geldt óók wanneer de uiteindelijke beslissing door een mens wordt genomen en het algoritme slechts een ondersteunende rol speelt.

In deze zaak ging het om de afwijzing van een visum kort verblijf. De minister maakte bij de beoordeling gebruik van het algoritme

[post_title] => Wat betekent de GPAI-Code of Practice voor AI-tools gebaseerd op general-purpose modellen?

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => wat-betekent-de-gpai-code-of-practice-voor-ai-tools-gebaseerd-op-general-purpose-modellen

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-04 10:32:23

[post_modified_gmt] => 2025-08-04 08:32:23

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45394

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

)

[post_count] => 10

[current_post] => -1

[before_loop] => 1

[in_the_loop] =>

[post] => WP_Post Object

(

[ID] => 45457

[post_author] => 6

[post_date] => 2025-08-13 10:19:13

[post_date_gmt] => 2025-08-13 08:19:13

[post_content] => De Rechtbank Den Haag heeft in een recente tussenuitspraak opnieuw benadrukt dat bestuursorganen verplicht zijn transparant te zijn over het gebruik van algoritmes in hun besluitvorming. Dat geldt óók wanneer de uiteindelijke beslissing door een mens wordt genomen en het algoritme slechts een ondersteunende rol speelt.

In deze zaak ging het om de afwijzing van een visum kort verblijf. De minister maakte bij de beoordeling gebruik van het algoritme Algoritmeregister als signaalfunctie

Rechters kijken steeds vaker actief in het Algoritmeregister. Vinden zij daar dat een bepaald algoritme wordt gebruikt, dan kan dat leiden tot een kritische toets: speelt het algoritme een rol bij de beslissing, en zo ja, is dat kenbaar en voldoende gemotiveerd? In deze uitspraak stelde de rechtbank vast dat het ontbreken van informatie over het gebruik van IOB in de besluitvorming een motiveringsgebrek opleverde. Dit gebrek moet worden hersteld, inclusief uitleg over de gegevensverwerking, de risicoprofilering en de betekenis van de ‘hits’ die in het dossier werden aangetroffen.

In deze uitspraak stelde de rechtbank vast dat het ontbreken van informatie over het gebruik van IOB in de besluitvorming een motiveringsgebrek opleverde. Dit gebrek moet worden hersteld, inclusief uitleg over de gegevensverwerking, de risicoprofilering en de betekenis van de ‘hits’ die in het dossier werden aangetroffen.

Lessen uit de kindertoeslagaffaire

De bestuursrechtspraak neemt het zekere voor het onzekere. De rechtbank verwijst expliciet naar de lessen uit de kindertoeslagaffaire, waarin achteraf bleek dat algoritmen discriminerend hadden gewerkt. Daarom legt de rechtbank nu zwaardere motiveringseisen op:- Vermeld expliciet wanneer een algoritme is gebruikt.

- Leg uit welke rol het heeft gespeeld bij het besluit.

- Geef inzicht in de mogelijke risico’s, zoals

bias of discriminatie.

Meer dan vakjes aankruisen

De rechter maakt ook korte metten met het idee dat een standaardformulier voldoende is om een besluit te motiveren. Onder verwijzing naar de Awb, het Handvest van de EU en het EVRM stelt de rechtbank dat de motivering concreet, op de zaak toegespitst en controleerbaar moet zijn. Algemene teksten of het simpelweg aanvinken van opties op een formulier zijn onvoldoende. Daarnaast wees de rechtbank op het belang van een hoorzitting in de bezwaarfase. Daarvan mag slechts worden afgezien als op voorhand vaststaat dat het bezwaar geen kans van slagen heeft. Dat was in deze zaak niet het geval.Lessen voor bestuursorganen

Deze uitspraak geeft een aantal duidelijke lessen:Registreer elk algoritme in het Algoritmeregister, ook als het alleen ondersteunend wordt ingezet.Wees proactief transparant in besluiten over de inzet, werking en invloed van het algoritme.Motiveer concreet – meer dan alleen vakjes aanvinken. Leg uit waarom de specifieke feiten en omstandigheden leiden tot het besluit.Voer een Impact Assessment Mensenrechten en Algoritmes (IAMA) uit, zeker bij algoritmes die risicoprofielen maken of gevoelige kenmerken gebruiken.Publiceer IAMA-rapporten, zodat burgers en rechters inzicht hebben in de risico’s en waarborgen.

Wat ik voor u kan doen

Als IT-advocaat (wijst@bg.legal) met een specialisatie in de juridische aspecten van AI ondersteun ik bestuursorganen bij:- Het verantwoord inzetten van

algoritmesin besluitvormingsprocessen. - Het vormgeven van transparantie en motivering, zodat besluiten juridisch houdbaar zijn.

- Het begeleiden van

IAMA’sen het correct vastleggen en publiceren van de resultaten.

[post_title] => Rechtbank: Transparantie over algoritmes in besluitvorming is geen optie maar verplichting

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => rechtbank-transparantie-over-algoritmes-in-besluitvorming-is-geen-optie-maar-verplichting

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-13 10:20:45

[post_modified_gmt] => 2025-08-13 08:20:45

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45457

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[comment_count] => 0

[current_comment] => -1

[found_posts] => 277

[max_num_pages] => 28

[max_num_comment_pages] => 0

[is_single] =>

[is_preview] =>

[is_page] =>

[is_archive] => 1

[is_date] =>

[is_year] =>

[is_month] =>

[is_day] =>

[is_time] =>

[is_author] =>

[is_category] =>

[is_tag] =>

[is_tax] => 1

[is_search] =>

[is_feed] =>

[is_comment_feed] =>

[is_trackback] =>

[is_home] =>

[is_privacy_policy] =>

[is_404] =>

[is_embed] =>

[is_paged] =>

[is_admin] =>

[is_attachment] =>

[is_singular] =>

[is_robots] =>

[is_favicon] =>

[is_posts_page] =>

[is_post_type_archive] =>

[query_vars_hash:WP_Query:private] => 142cd08274a5c5faff512379bc31bff8

[query_vars_changed:WP_Query:private] => 1

[thumbnails_cached] =>

[allow_query_attachment_by_filename:protected] =>

[stopwords:WP_Query:private] =>

[compat_fields:WP_Query:private] => Array

(

[0] => query_vars_hash

[1] => query_vars_changed

)

[compat_methods:WP_Query:private] => Array

(

[0] => init_query_flags

[1] => parse_tax_query

)

[query_cache_key:WP_Query:private] => wp_query:fd2e3db9653ba968f04925ce42ebe132

[tribe_is_event] =>

[tribe_is_multi_posttype] =>

[tribe_is_event_category] =>

[tribe_is_event_venue] =>

[tribe_is_event_organizer] =>

[tribe_is_event_query] =>

[tribe_is_past] =>

[tribe_controller] => Tribe\Events\Views\V2\Query\Event_Query_Controller Object

(

[filtering_query:Tribe\Events\Views\V2\Query\Event_Query_Controller:private] => WP_Query Object

*RECURSION*

)

)

[post_title] => Rechtbank: Transparantie over algoritmes in besluitvorming is geen optie maar verplichting

[post_excerpt] =>

[post_status] => publish

[comment_status] => open

[ping_status] => open

[post_password] =>

[post_name] => rechtbank-transparantie-over-algoritmes-in-besluitvorming-is-geen-optie-maar-verplichting

[to_ping] =>

[pinged] =>

[post_modified] => 2025-08-13 10:20:45

[post_modified_gmt] => 2025-08-13 08:20:45

[post_content_filtered] =>

[post_parent] => 0

[guid] => https://bg.legal/?p=45457

[menu_order] => 0

[post_type] => post

[post_mime_type] =>

[comment_count] => 0

[filter] => raw

)

[comment_count] => 0

[current_comment] => -1

[found_posts] => 277

[max_num_pages] => 28

[max_num_comment_pages] => 0

[is_single] =>

[is_preview] =>

[is_page] =>

[is_archive] => 1

[is_date] =>

[is_year] =>

[is_month] =>

[is_day] =>

[is_time] =>

[is_author] =>

[is_category] =>

[is_tag] =>

[is_tax] => 1

[is_search] =>

[is_feed] =>

[is_comment_feed] =>

[is_trackback] =>

[is_home] =>

[is_privacy_policy] =>

[is_404] =>

[is_embed] =>

[is_paged] =>

[is_admin] =>

[is_attachment] =>

[is_singular] =>

[is_robots] =>

[is_favicon] =>

[is_posts_page] =>

[is_post_type_archive] =>

[query_vars_hash:WP_Query:private] => 142cd08274a5c5faff512379bc31bff8

[query_vars_changed:WP_Query:private] => 1

[thumbnails_cached] =>

[allow_query_attachment_by_filename:protected] =>

[stopwords:WP_Query:private] =>

[compat_fields:WP_Query:private] => Array

(

[0] => query_vars_hash

[1] => query_vars_changed

)

[compat_methods:WP_Query:private] => Array

(

[0] => init_query_flags

[1] => parse_tax_query

)

[query_cache_key:WP_Query:private] => wp_query:fd2e3db9653ba968f04925ce42ebe132

[tribe_is_event] =>

[tribe_is_multi_posttype] =>

[tribe_is_event_category] =>

[tribe_is_event_venue] =>

[tribe_is_event_organizer] =>

[tribe_is_event_query] =>

[tribe_is_past] =>

[tribe_controller] => Tribe\Events\Views\V2\Query\Event_Query_Controller Object

(

[filtering_query:Tribe\Events\Views\V2\Query\Event_Query_Controller:private] => WP_Query Object

*RECURSION*

)

)

13 aug 2025

11 jul 2025